ВВЕДЕНИЕ

Современные распределенные системы машинного обучения (РСМО) используются в инфраструктурах крупных цифровых платформ, телекоммуникационных операторов, финансовых организаций и облачных провайдеров [1]. Рост объемов данных и требований к времени отклика привел к необходимости развертывания моделей в средах с высокой нагрузкой, где критическими параметрами становятся масштабируемость, отказоустойчивость и предсказуемость производительности. В 2021-2025 гг. большинство промышленных решений в области машинного обучения (МО) ориентированы на облачную или гибридную архитектуру с микросервисным взаимодействием компонентов [2].

Высоконагруженные среды предъявляют комплексные требования к архитектуре: необходимо обеспечить устойчивость к пиковым значениям запросов, изоляцию вычислительных контуров, контроль версионности моделей и непрерывность поставки обновлений. Нарушение согласованности между этапами жизненного цикла модели – от подготовки данных до эксплуатации – приводит к деградации качества предсказаний, увеличению задержек и росту операционных затрат. В этих условиях управление жизненным циклом МО (Machine Learning Lifecycle Management, MLLM) становится самостоятельной инженерной задачей.

Целью настоящей статьи является систематизация архитектурных подходов и методов управления жизненным циклом распределенных систем машинного обучения в условиях высокой нагрузки, а также анализ факторов, влияющих на устойчивость и производительность таких систем на этапах разработки, развертывания и эксплуатации.

ОСНОВНАЯ ЧАСТЬ

Архитектура РСМО, функционирующей в условиях высокой нагрузки, как правило, включает следующие логические уровни: слой сбора и подготовки данных, вычислительный слой обучения, слой оркестрации моделей и слой онлайн-инференса. В современных реализациях данные уровни разворачиваются в контейнеризованной среде с использованием оркестрации (например, Kubernetes) [3], что обеспечивает горизонтальное масштабирование и изоляцию сервисов. При этом вычислительные кластеры могут включать специализированные ускорители (GPU/TPU), распределенные по нескольким узлам.

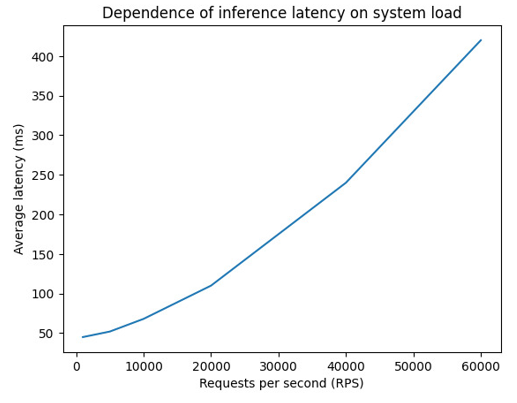

Ключевым параметром функционирования является задержка инференса при росте нагрузки. На рисунке 1 представлена зависимость средней задержки от интенсивности входящих запросов.

Рисунок 1. Зависимость задержки инференса от уровня нагрузки [3]

Как видно из рисунка 1, при увеличении числа запросов в секунду наблюдается нелинейный рост задержки. До определенного порога система функционирует в режиме линейной масштабируемости, однако при достижении предельных значений вычислительных ресурсов происходит резкое увеличение времени отклика.

Представленная динамика обусловлена насыщением очередей обработки, конкуренцией за ресурсы процессора и памяти, а также ограничениями пропускной способности сетевой инфраструктуры. В условиях промышленной эксплуатации подобная деградация может приводить к нарушению соглашений об уровне сервиса (SLA) и снижению качества пользовательского опыта.

Для предотвращения подобных эффектов в РСМО применяются механизмы автоскейлинга, кэширования результатов инференса, батчирования запросов и балансировки нагрузки [4]. При этом выбор стратегии масштабирования зависит от профиля трафика и требований к латентности. Например, системы реального времени требуют минимизации задержек, тогда как аналитические платформы допускают обработку в асинхронном режиме.

Не менее значимым элементом архитектуры является управление версиями моделей. В распределенной среде одновременно могут функционировать несколько версий одной модели – для A/B-тестирования, канареечного развертывания или поэтапной миграции. Отсутствие централизованного контроля версий повышает риск несовместимости входных данных и предсказаний.

С точки зрения инфраструктуры, критическим становится разграничение контуров обучения и инференса. Обучающие процессы характеризуются высокой вычислительной интенсивностью, тогда как инференс требует предсказуемости и минимальной задержки. Их совместное размещение на одних узлах увеличивает вероятность деградации производительности при пиковых нагрузках [5].

В таблице 1 представлено сопоставление архитектурных подходов к организации высоконагруженных РСМО.

Таблица 1. Сравнение архитектурных подходов [6]

|

Подход |

Преимущества |

Ограничения |

Область применения |

| Монолитная архитектура | Простота реализации | Низкая масштабируемость | Прототипирование |

| Микросервисная архитектура | Гибкость и масштабируемость | Сложность оркестрации | Онлайн-сервисы |

| Событийно-ориентированная архитектура | Высокая устойчивость | Повышенные требования к инфраструктуре | Потоковая аналитика |

Из таблицы 1 следует, что для высоконагруженных сценариев предпочтительной является микросервисная или событийно-ориентированная архитектура. Однако их внедрение требует развитой системы мониторинга и управления конфигурациями.

Дополнительно следует учитывать вопросы безопасности и изоляции данных. В распределенных системах возможны риски утечки конфиденциальной информации при передаче между сервисами. Поэтому применяются механизмы шифрования каналов связи, а также контроль доступа на уровне сервисных аккаунтов.

Управление жизненным циклом моделей

Жизненный цикл модели МО включает этапы сбора данных, подготовки, обучения, валидации, развертывания, мониторинга и вывода из эксплуатации. В распределенных системах данные этапы автоматизируются в рамках концепции MLOps. Интеграция CI/CD-подходов позволяет сократить время вывода обновлений и повысить воспроизводимость экспериментов [7].

Особое значение приобретает мониторинг качества модели в продакшн-среде. Помимо технических метрик (загрузка CPU, время отклика), анализируются метрики качества предсказаний и признаки дрейфа данных. При выявлении статистически значимого отклонения запускается процедура переобучения.

В 2021-2025 гг. распространение получили централизованные хранилища артефактов моделей (Model Registry), обеспечивающие контроль версий и метаданных. Это позволяет фиксировать параметры обучения, используемые датасеты и гиперпараметры, что повышает прозрачность и управляемость процессов.

Автоматизация MLLM снижает вероятность человеческой ошибки, однако повышает требования к инфраструктурной зрелости организации. Без формализованных регламентов обновление моделей может привести к нарушению согласованности сервисов и временной недоступности системы.

Обеспечение устойчивости и отказоустойчивости

Высоконагруженные РСМО функционируют в условиях постоянной изменчивости нагрузки и инфраструктурных рисков. Отказ одного узла не должен приводить к полной остановке сервиса. Для этого применяются механизмы репликации, распределенного хранения состояний и автоматического перезапуска контейнеров.

Практика 2021-2025 гг. показывает, что наиболее эффективной является стратегия горизонтального масштабирования с избыточностью ресурсов. Поддержание резерва вычислительной мощности позволяет компенсировать кратковременные пики нагрузки без деградации производительности.

Важным инструментом является распределенный мониторинг с централизованным сбором логов и метрик [8]. Это позволяет выявлять узкие места архитектуры и прогнозировать потенциальные точки отказа до возникновения критической ситуации.

Кроме того, устойчивость системы зависит от корректной сегментации сервисов. Минимизация взаимозависимостей между компонентами снижает каскадный эффект при сбоях. В условиях высокой нагрузки такая декомпозиция является обязательным требованием к проектированию архитектуры.

Таким образом, архитектура и управление жизненным циклом распределенных систем машинного обучения в условиях высокой нагрузки требуют комплексного подхода, включающего масштабируемую инфраструктуру, автоматизацию процессов MLLM, контроль версионности и развитую систему мониторинга. Заявленная цель исследования – систематизация архитектурных и организационных механизмов обеспечения устойчивости и управляемости РСМО – достигнута посредством анализа ключевых инженерных решений и факторов, влияющих на их эффективность.

ЗАКЛЮЧЕНИЕ

Проведенный анализ архитектурных подходов к построению распределенных систем машинного обучения показал, что при высокой нагрузке ключевыми факторами эффективности являются модульность, масштабируемость и устойчивость к отказам. Современные практики, основанные на микросервисной оркестрации, позволяют обеспечить предсказуемое поведение системы даже при экстремальных значениях входящих запросов. При этом недостаточное внимание к балансировке ресурсов и управлению версиями моделей может привести к деградации качества сервиса.

Исследование аспектов управления жизненным циклом моделей выявило необходимость строгой автоматизации процессов, начиная с подготовки данных и заканчивая мониторингом инференса в продакшн-среде. Инструменты класса MLOps, включая регистраторы моделей и механизмы непрерывной интеграции и доставки, повышают воспроизводимость экспериментов и позволяют оперативно реагировать на изменение характеристик данных. Важно учитывать риски дрейфа данных и своевременно адаптировать модели, чтобы сохранить качество предсказаний.

Наконец, обеспечение устойчивости РСМО достигается за счет репликации, изоляции вычислительных контуров и распределенного мониторинга. Эти меры позволяют снизить влияние сбоев отдельных узлов на общую работоспособность системы. Комплексный подход к архитектуре и MLLM обеспечивает не только техническую надежность, но и экономическую эффективность эксплуатации высоконагруженных систем машинного обучения.

Библиографический список

- Mukayev T. Development of adaptive machine learning models for high-load information systems // International Journal of Advanced Research in Science, Communication and Technology. 2025. Vol. 14(4). P. 194-198.

- Miguel G. Rodrigues, Eduardo K. Viegas, Altair O. A MLOps architecture for near real-time distributed Stream Learning operation deployment // Journal of Network and Computer Applications. 2025. Vol. 238, P. 104169.

- Zeydan E., Arslan S.S., Liyanage M. Managing Distributed Machine Learning Lifecycle for Healthcare Data in the Cloud // IEEE. 2024. Vol. 12. P. 115750-115774.

- Mukayev T. Modern methods of monitoring and logging in distributed machine learning systems // Theoretical & Applied Science. 2025. Vol. 153(1). P. 144-151.

- Nuzhdin D. Architectural patterns and performance optimization in mobile applications: implementing scalable solutions on iOS under high user load // ISJ Theoretical & Applied Science. 2025. Vol. 148(8). P. 1-6.

- Thangavel S., Srinivasan S., Venkata Naga S.B., Narukulla K. Distributed Machine Learning for Big Data Analytics: Challenges, Architectures, and Optimizations // IJAIDSML. 2023. Vol. 4(3). P. 18-30.

- Maksimov V. Enhancing OCR performance with parallel computing and GPU acceleration in Java-based document processing // Professional Bulletin: Information Technology and Security. 2025. № 4/2025. P. 18-25.

- Bellocchi M. System principles of reliability and resilience: integration of fault-tolerant architectures and interface solutions // Cold Science. 2025. № 21. P. 13-21.